ونحن نعلم أن Apple من المهم جدًا الحفاظ على سرية البيانات التي تمر عبر الأجهزة في النظام البيئي وأن تكون محمية جيدًا من أعين المتطفلين. ومع ذلك ، فهذا لا يعني أنه لا يتعين على المستخدمين الامتثال للقواعد المتعلقة بالأخلاق والأخلاق ولماذا لا ، الإنسانية.

Apple أعلنت أنها ستطلق قريبًا تقنية قادرة على مسح جميع الصور المخزنة من قبل المستخدمين في iCloud والتعرف على الصور التي تحتوي على اعتداء جنسي على الأطفال. مواد الاعتداء الجنسي على الأطفال (CSAM).

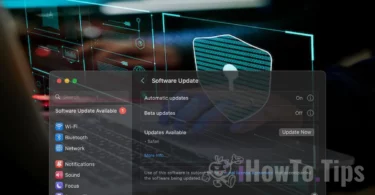

سيتم إطلاق هذه التكنولوجيا بواسطة Apple قرب نهاية هذا العام ، على الأرجح في إصدار تجريبي ، لعدد قليل من المستخدمين.

إذا كنت تتساءل "أين هي سرية البيانات؟" ، اكتشف أن كل شيء نتلقى المحتوى فيديو / صورة يتم ذلك من خلال بروتوكول مشفر. بالإضافة إلى تخزين البيانات بتنسيق iCloud إنه مشفر ، لكن مقدمي هذه الخدمات لديهم المفتاح لتشفير البيانات. هنا نقول ليس فقط من Apple. Microsoft و Google وخدمات تخزين البيانات الأخرى بتنسيق cloud أنا أفعل الشيء نفسه.

يمكن فك تشفير البيانات المخزنة والتحقق منها إذا طُلبت في إجراء قانوني أو إذا كانت تنتهك القوانين بشكل صارخ. مثل تلك المتعلقة بأعمال العنف ضد الأطفال والنساء.

للحفاظ على سرية المستخدمين ، تعتمد الشركة على تقنية جديدة تسمى NeuralHash ، والتي ستقوم بمسح الصور ضوئيًا من iCloud وسيحدد تلك التي تحتوي على عنف ضد الأطفال من خلال مقارنتها بصور أخرى في قاعدة بيانات.

إنه يشبه إلى حد ما التعرف على الوجه أو التعرف الذكي على الأشياء والحيوانات والعناصر الأخرى.

ستكون التقنية قادرة على مسح الصور التي تم التقاطها أو نقلها من خلال جهاز iPhone أو iPad أو Mac والتحقق منها ، حتى لو خضعت للتغييرات.